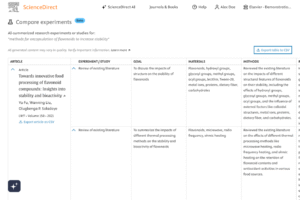

24 فوریه 2025-یک تلفن هوشمند که نمادهای برنامه های هوش مصنوعی را نشان می دهد، عکس توسط lixu/Getty Images-کارتر پرایس -براین آلکیره

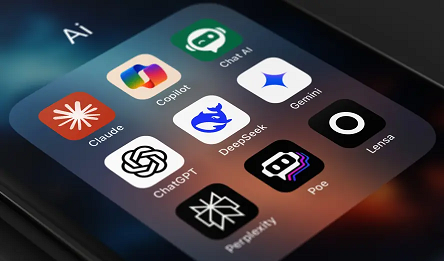

مدل R1 شرکت چینی DeepSeek وارد حوزه شلوغی از مدلهای زبان بزرگ (LLM) شد که تحت تسلط شرکتهای آمریکایی از جمله Anthropic، Google، Meta و OpenAI بود.

R1 هنگامی که چند هفته پیش عرضه شد، به سرعت به یکی از بهترین مدلهای هوش مصنوعی تبدیل شد. R1 همچنین برای توسعه و اجرا ارزانتر از رقبای اصلی بود. در حال حاضر این برنامه بالاتر از برنامه OpenAI در اپ استور اپل است. اساساً، این نشان دهنده شکست تلاش های سیاست ایالات متحده برای مهار پیشرفت هوش مصنوعی چین، از جمله تلاش برای محدود کردن پیشرفت چین از طریق محدود کردن فروش تراشه است. با این حال، درس هایی وجود دارد که می توان از این تجربه آموخت که ممکن است به شکل دادن به سیاست ایالات متحده و پیشبرد منافع ایالات متحده در رقابت هوش مصنوعی با چین کمک کند.

توسعه و اجرای R1 نسبت به رقبای کلیدی ارزانتر بود. این برنامه در حال حاضر بالاتر از برنامه OpenAI در اپ استور اپل برتر است. اساساً، این نشان دهنده شکست تلاش های سیاست ایالات متحده برای مهار پیشرفت هوش مصنوعی چین است. مقاله ای که مدل و توسعه آن را توصیف می کند، سه نوع پیشرفت بزرگ را شرح می دهد.

در حالی که اکثر LLM ها از تنظیم دقیق نظارت شده برای بهبود عملکرد استفاده می کنند، DeepSeek از فرآیند یادگیری تقویتی اضافی (RL) استفاده می کند. RL یک نوع یادگیری ماشینی است که به طور گسترده مورد استفاده قرار میگیرد که در آن مدلها یاد میگیرند که وظایف را با آزمایش روشهای مختلف و سپس دریافت پاداش بر اساس نتیجه انجام دهند. با گذشت زمان، مدل استراتژیهایی را پیدا میکند که در انجام کار مؤثر هستند. تیم DeepSeek یک تابع پاداش جدید و رویکرد تولید استراتژی ایجاد کرد که منجر به یادگیری سریعتر شد. این مرحله هزینه آموزش مدل را کاهش داد.

پیشرفت بزرگ بعدی استفاده از تکنیکی به نام تحلیل خاص یا تقطیر برای برداشتن یک مدل بزرگ و سپس تقطیر آن تنها به مهمترین قسمتها به گونهای بود که اندازه کلی و در نتیجه هزینه اجرای آن را به میزان قابل توجهی کاهش دهد.

پیشرفت نهایی آنها شامل یک رویکرد “استدلال” جدید مشابه مدل o1 OpenAI بود.

در حالی که آنها اولین مدلی نبودند که از این تکنیک ها استفاده می کردند، تیم DeepSeek پیاده سازی های جدیدی برای هر کدام دارد. علاوه بر این، آنها جزئیات کافی را در مقاله کاری خود ارائه کردند که سایر محققین و توسعه دهندگان بتوانند این تکنیک ها را در کار خود قرار دهند، که نشان دهنده مزیت همه انجام کار در فضای باز است.

چندین پیامد برای سیاستگذاران ایالات متحده وجود دارد:

در حالی که DeepSeek دقیقاً یک رقیب جدید نیست، دستاورد آنها نشان می دهد که مانع ورود به اندازه کافی کم است که ورودی های جدید بتوانند رقابتی باشند. بنابراین، برای انتخاب برنده و بازنده خیلی زود است.

DeepSeek R1 را با وزنههای باز عرضه کرد، برخلاف مدلهای با وزن بسته که توسط اکثر شرکتهای ایالات متحده منتشر شد. مدلهای وزنی باز هزینه محاسبه برای هزینههای استنتاج را از توسعهدهنده مدل به میزبان مدل منتقل میکنند. این باعث کاهش قدرت قیمت گذاری ارائه دهندگان مدل با وزن بسته می شود.

تغییر به مدلهای استدلال هزینههای محاسباتی را از آموزش به استنتاج، حداقل به طور نسبی، منتقل میکند. بنابراین، مدلهای وزن باز مانند R1 را میتوان در چین توسعه داد، اما نیازی به استنباط در چین نیست. این رویکرد میتواند دسترسی شرکتهای چینی به سهم بازار را افزایش دهد زیرا محاسبه برای استنتاج میتواند در جای دیگری ارائه شود.

توسعه عوامل هوش مصنوعی فقط محاسبات بیشتری را از آموزش به استنتاج سوق می دهد و سهم زمان محاسباتی صرف شده در مرحله آموزش را کاهش می دهد. شرکتهایی که مدلهای خود را قبل از بهینهسازی پیادهسازیهایشان مقیاسبندی میکنند، درحال ضرر قابل توجهی هستند زیرا هزینههای آموزش و استنباط بالاتری خواهند داشت.

سیاستهای ایالات متحده که دسترسی چین به تراشهها را برای آموزش محدود میکند، شرکتهای چینی را به تمرکز بر بهینهسازی عملکرد به روشهایی که منجر به کاهش هزینههای آموزشی برای مدلها و همچنین استنتاج ارزانتر میشود، سوق داد.

سیاستهای ایالات متحده که دسترسی چین به تراشهها را برای آموزش محدود میکند، شرکتهای چینی را به تمرکز بر بهینهسازی عملکرد به روشهایی که منجر به کاهش هزینههای آموزشی برای مدلها و همچنین استنتاج ارزانتر میشود، سوق داد. به طور مشابه، تمرکز سیاست ایالات متحده بر روی تراشههایی که برای آموزش بهینهسازی شدهاند، در دنیایی که بیشتر هزینههای محاسباتی صرف آموزش مدلهای بزرگتر میشود، منطقی است، اما همانطور که میدان به سمت زمان محاسباتی صرف شده در استنتاج میرود، محدودیتهای فعلی کاملاً به نقطهنظر نمیرسند.

در حالی که سیاستهای فعلی ایالات متحده نتوانسته است شرکتهای چینی هوش مصنوعی را از رقبای همتا با شرکتهای آمریکایی بازدارد، رقابت برای هوش مصنوعی هنوز به پایان نرسیده است. به قول وینستون چرچیل، «…این پایان کار نیست. حتی آغاز پایان هم نیست. اما شاید پایان آغاز باشد.»