اکتبر 13، 2023 -بوسیله Cell Press-اعتبار: Pixabay / CC0 دامنه عمومی

برای بررسی وضعیت جهانی اخلاق هوش مصنوعی، یک تیم از محققان برزیلی یک بررسی سیستماتیک و متاانالیز از دستورالعمل های جهانی برای استفاده از هوش مصنوعی انجام دادند. محققان با انتشار مطلبیدر 13 اکتبر در مجله Patterns دریافتند که در حالی که اکثر دستورالعمل ها برای حریم خصوصی، شفافیت و پاسخگویی ارزش قائل هستند، تعداد بسیار کمی از انها برای صداقت، مالکیت معنوی یا حقوق کودکان ارزش قائل هستند. علاوه بر این، اکثر دستورالعمل ها اصول و ارزش های اخلاقی را بدون پیشنهاد روش های عملی برای اجرای انها و بدون فشار برای مقررات قانونی الزام اور توصیف می کنند.

این را دانشمند علوم اجتماعی و نویسنده جیمز ویلیام سانتوس از دانشگاه کاتولیک پاپی ریو گراند دو سول می گوید:

“ایجاد دستورالعمل های اخلاقی روشن و ساختارهای حکومتی برای استقرار هوش مصنوعی در سراسر جهان اولین گام برای ترویج اعتماد و اطمینان، کاهش خطرات ان و اطمینان از اینکه مزایای ان به طور عادلانه توزیع می شود.

نویسنده اصلی نیکلاس Kluge Corrêa از دانشگاه کاتولیک پاپی ریو گراند دو سول و دانشگاه بن می گوید:

“کار قبلی عمدتا در محدوده اسناد امریکای شمالی و اروپایی متمرکز شده است، که باعث شد ما به طور فعال به دنبال و شامل دیدگاه از مناطق مانند اسیا، امریکای لاتین، افریقا و فراتر از ان، هستیم.

برای تعیین اینکه ایا یک اجماع جهانی در مورد توسعه اخلاقی و استفاده از هوش مصنوعی وجود دارد و برای کمک به هدایت چنین اجماع، محققان یک بررسی سیستماتیک از سیاست ها و دستورالعمل های اخلاقی منتشر شده بین 2014 و 2022 انجام دادند.

از این رو، انها ۲۰۰ سند مربوط به اخلاق هوش مصنوعی و حکومتداری از ۳۷ کشور و شش قاره را شناسایی کردند و به پنج زبان مختلف (انگلیسی، پرتغالی، فرانسوی، المانی و اسپانیایی) نوشته یا ترجمه شدند. این اسناد شامل توصیه ها، راهنماهای عملی، چارچوب های سیاسی، نشانه های قانونی و کدهای رفتاری بود.

سپس، تیم یک متاانالیز از این اسناد برای شناسایی رایج ترین اصول اخلاقی، بررسی توزیع جهانی انها و ارزیابی تعصبات از نظر نوع سازمان ها یا افرادی که این اسناد را تولید می کنند، انجام داد.

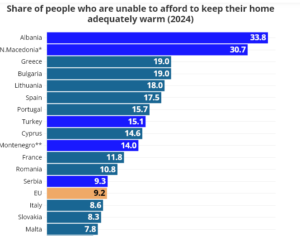

محققان دریافتند که رایج ترین اصول شفافیت، امنیت، عدالت، حریم خصوصی و پاسخگویی است که به ترتیب در 82.5٪، 78٪، 75.5٪، 68.5٪ و 67٪ از اسناد ظاهر شد.

کمترین اصول مشترک حقوق کار، صداقت، مالکیت معنوی و حقوق کودکان / نوجوانان بود که در 19.5٪، 8.5٪، 7٪ و 6٪ از اسناد ظاهر شد و نویسندگان تاکید می کنند که این اصول سزاوار توجه بیشتری هستند. به عنوان مثال، صداقت – این ایده که هوش مصنوعی باید اطلاعات صادقانه را ارائه دهد – به طور فزاینده ای با انتشار فن اوری های هوش مصنوعی مولد مانند ChatGPT مرتبط است. و از انجا که هوش مصنوعی پتانسیل جابجایی کارگران و تغییر نحوه کار ما را دارد، اقدامات عملی برای جلوگیری از بیکاری گسترده یا انحصارات است.

اکثر (96٪) دستورالعمل ها “هنجاری” بودند – توصیف ارزش های اخلاقی که باید در طول توسعه و استفاده از هوش مصنوعی در نظر گرفته شود – در حالی که تنها 2٪ روش های عملی اجرای اخلاق هوش مصنوعی را توصیه می کنند و تنها 4.5٪ اشکال قانونی الزام اور مقررات AI را پیشنهاد می کنند.

سانتوس می گوید: “این بیشتر تعهدات داوطلبانه است که می گوید: “اینها برخی از اصول هستند که ما مهم هستیم”، اما انها فاقد اجرای عملی و الزامات قانونی هستند.” “اگر شما در حال تلاش برای ساخت سیستم های هوش مصنوعی هستید یا اگر از سیستم های هوش مصنوعی در کسب و کار خود استفاده می کنید، باید به چیزهایی مانند حریم خصوصی و حقوق کاربر احترام بگذارید، اما نحوه انجام این کار منطقه خاکستری است که در این دستورالعمل ها ظاهر نمی شود.”

محققان همچنین چندین تعصب را از نظر جایی که این دستورالعمل ها تولید شده و چه کسی انها را تولید کرده است، شناسایی کردند. محققان به اختلاف جنسیتی از نظر نویسندگی اشاره کردند. اگر چه 66٪ از نمونه ها هیچ اطلاعاتی در مورد نویسنده نداشتند، نویسندگان اسناد باقی مانده اغلب نام های مردانه داشتند (549 = 66٪ مرد، 281 = 34٪ زن).

از لحاظ جغرافیایی، بیشتر دستورالعمل ها از کشورهای اروپای غربی (31.5٪)، امریکای شمالی (34.5٪) و اسیا (11.5٪) امده است، در حالی که کمتر از 4.5٪ از اسناد در امریکای جنوبی، افریقا و اقیانوسیه ترکیب شده است. برخی از این عدم تعادل در توزیع ممکن است به دلیل محدودیت های زبان و دسترسی عمومی باشد، اما این تیم می گوید که این نتایج نشان می دهد که بسیاری از بخش های جنوب جهانی در گفتمان جهانی در مورد اخلاق هوش مصنوعی کمتر نشان داده شده است.

در برخی موارد، این شامل کشورهایی است که به شدت درگیر تحقیق و توسعه هوش مصنوعی هستند، مانند چین، که خروجی تحقیقات مربوط به هوش مصنوعی بین سال های 2016 و 2019 بیش از 120٪ افزایش یافته است.

کامیلا Galvão از دانشگاه کاتولیک پاپی ریو گراند دو سول می گوید :

“تحقیقات ما نشان می دهد و تقویت تماس ما برای جنوب جهانی به بیدار شدن و درخواست برای شمال جهانی اماده برای گوش دادن و استقبال از ما می باشد،. ما نباید فراموش کنیم که در دنیایی چندگانه، نابرابر و متنوع زندگی میکنیم. ما باید صداهایی را به یاد بیاوریم که تا کنون فرصتی برای ادعای ترجیحات خود، توضیح زمینه های خود و شاید چیزی را به ما بگویند که هنوز نمی دانیم.

علاوه بر ترکیب صداهای بیشتر، محققان می گویند که تلاش های اینده باید بر چگونگی اجرای اصول اخلاق هوش مصنوعی تمرکز کند. سانتوس می گوید: “گام بعدی ایجاد یک پل بین اصول انتزاعی اخلاق و توسعه عملی سیستم های هوش مصنوعی و برنامه های کاربردی است.”