14 آگوست 2023 -توسط ماکس وست و سارا عرفانی، دانشگاه ملبورن-آسیبپذیری شبکههای عصبی نگرانیهای ایمنی را در موقعیتهای بالقوه تهدیدکننده زندگی مانند خودروهای خودران افزایش میدهد. اعتبار: Shutterstock

یادگیری ماشینی زمینهای از هوش مصنوعی (AI) است که در آن مدلهای کامپیوتری با مصرف مقادیر زیادی داده در کارهای مختلف متخصص میشوند. این روش به جای این است که یک انسان این سطح از تخصص را برنامه ریزی کند.

برای مثال، هوش مصنوعیهای شطرنج مدرن نیازی به آموزش استراتژیهای شطرنج توسط استادان بزرگ انسان ندارند، بلکه میتوانند آنها را به طور مستقل با انجام میلیونها بازی در برابر نسخههای خود، «یاد بگیرند».

این در شرایطی که نوشتن دستورالعملهای صریح غیرعملی است، اگر غیرممکن نباشد، بسیار ارزشمند است – چگونه یک تابع ریاضی را تعریف میکنید که میتواند به شما بگوید که یک تصویر حاوی گربه یا سگ است؟

کودکان انسان هرگز چنین عملکردی را یاد نمی گیرند، بلکه نمونه های زیادی از گربه ها و سگ ها را می بینند، سپس در نهایت تفاوت های آنها را درک می کنند.یادگیری ماشینی در مورد تکرار این فرآیند در رایانه است.

اما علیرغم موفقیتهای باورنکردنی و گسترش روزافزون، چارچوبهای مبتنی بر یادگیری ماشینی به شدت مستعد حملات دشمن هستند – یعنی دستکاری مخرب در دادههایشان که باعث شکست آنها به روشهای شگفتآوری میشود.

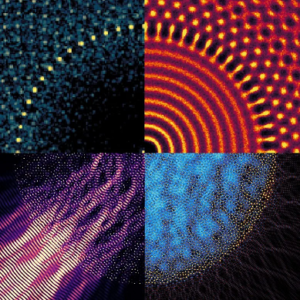

به عنوان مثال، مدلهای طبقهبندی تصویر (که عکسها را برای شناسایی و تشخیص طیف گستردهای از معیارها تجزیه و تحلیل میکنند) اغلب میتوانند با افزودن تغییرات خوشساخت (معروف به اغتشاش) به تصاویر ورودیشان فریب بخورند که آنقدر کوچک هستند که توسط چشم انسان قابل تشخیص نیستند. و این می تواند مورد سوء استفاده قرار گیرد.

آسیبپذیری مستمر در برابر حملاتی مانند این نیز سؤالات جدی در مورد ایمنی استقرار شبکههای عصبی یادگیری ماشین در موقعیتهای بالقوه تهدیدکننده زندگی ایجاد میکند. این امر شامل برنامههایی مانند خودروهای خودران میشود، که در آن سیستم میتواند با عبور از یک تقاطع توسط یک قطعه گرافیتی بیضرر روی تابلوی توقف اشتباه گرفته شود.

در زمان حاضر که توسعه و استقرار هوش مصنوعی به سرعت در حال تکامل است، تیم تحقیقاتی ما به دنبال راههایی هستند که بتوانیم از محاسبات کوانتومی برای محافظت از هوش مصنوعی در برابر این آسیبپذیریها استفاده کنیم.

یادگیری ماشین و محاسبات کوانتومی

پیشرفت های اخیر در محاسبات کوانتومی هیجان زیادی را در مورد چشم انداز افزایش یادگیری ماشین با کامپیوترهای کوانتومی ایجاد کرده است. الگوریتمهای مختلف «یادگیری ماشین کوانتومی» قبلاً پیشنهاد شدهاند، از جمله تعمیم کوانتومی روشهای کلاسیک استاندارد.

تعمیم به توانایی یک مدل یادگیری برای انطباق مناسب با داده های جدید و قبلاً دیده نشده اشاره دارد.اعتقاد بر این است که مدلهای یادگیری ماشینی کوانتومی میتوانند انواع خاصی از دادهها را به شدت سریعتر از هر مدلی که برای رایانههای فعلی یا «کلاسیک» طراحی شده است، یاد بگیرند.رایانههای معمولی با بیتهایی از داده کار میکنند که میتوانند «صفر» یا «یک» باشند – یک سیستم کلاسیک دو سطحی.

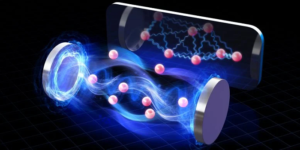

رایانههای کوانتومی با «کیوبیتها» کار میکنند، حالتهایی از سیستمهای کوانتومی دو سطحی، که ویژگیهای اضافی عجیب و غریبی از خود نشان میدهند که میتوان آنها را برای مقابله با مشکلات خاص با کارآمدتر از همتایان کلاسیک خود مهار کرد.

با این حال، چیزی که کمتر مشخص است، این است که این افزایش سرعت چقدر گسترده خواهد بود و یادگیری ماشین کوانتومی در عمل چقدر مفید خواهد بود.این به این دلیل است که اگرچه انتظار میرود رایانههای کوانتومی به طور مؤثر کلاس وسیعتری از مدلها را نسبت به همتایان کلاسیک خود بیاموزند، هیچ تضمینی وجود ندارد که این مدلهای جدید برای اکثر وظایف یادگیری ماشینی که مردم واقعاً به آنها علاقه دارند مفید باشند. اینها ممکن است شامل مشکلات طبقه بندی پزشکی یا سیستم های هوش مصنوعی مولد باشند.

این چالشها تیم ما را برانگیخت تا در نظر بگیرد که محاسبات کوانتومی چه مزایای دیگری میتواند برای وظایف یادگیری ماشین به ارمغان بیاورد – به غیر از اهداف معمول بهبود کارایی یا دقت.

محافظت از هوش مصنوعی در برابر حملات

در آخرین کار ما که در Physical Review Research منتشر شده است، پیشنهاد میکنیم که مدلهای یادگیری ماشین کوانتومی ممکن است بهتر در برابر حملات خصمانه تولید شده توسط رایانههای کلاسیک دفاع شوند.

حملات خصمانه با شناسایی و بهره برداری از ویژگی های مورد استفاده توسط یک مدل یادگیری ماشینی کار می کنند.اما ویژگیهایی که توسط مدلهای یادگیری ماشین کوانتومی عمومی استفاده میشوند، برای رایانههای کلاسیک غیرقابل دسترسی هستند، و بنابراین برای دشمنی که فقط به منابع محاسباتی کلاسیک مسلح شده است، قابل مشاهده نیستند.

این ایدهها همچنین میتوانند برای شناسایی وجود حملات متخاصم با استفاده همزمان از شبکههای کلاسیک و کوانتومی مورد استفاده قرار گیرند.در شرایط عادی، هر دو شبکه باید پیشبینیهای یکسانی را انجام دهند، اما در صورت حمله، خروجیهای آنها متفاوت خواهد بود.

در حالی که این امر دلگرم کننده است، یادگیری ماشین کوانتومی همچنان با چالش های مهمی مواجه است. در میان آنها شکاف عظیمی است که سخت افزار محاسباتی کلاسیک و کوانتومی را از هم جدا می کند.

کامپیوترهای کوانتومی امروزی به طور قابل توجهی به دلیل اندازه و میزان خطای بالای خود محدود می شوند، که آنها را از انجام محاسبات طولانی باز می دارد.

چالش بزرگ مهندسی باقی می ماند، اما اگر بتوان بر اینها غلبه کرد، بدون شک قابلیت های منحصر به فرد کامپیوترهای کوانتومی در مقیاس بزرگ مزایای شگفت انگیزی را در طیف وسیعی از زمینه ها به ارمغان خواهد آورد.