30 مه 2023 -توسط جوزف بویل

ChatGPT در اواخر سال گذشته مورد توجه قرار گرفت و سرمایهگذاری عظیمی را برانگیخت و همچنین انتقادات گستردهای را برانگیخت.

گروهی از روسای صنعت و کارشناسان هشدار دادند که رهبران جهانی باید برای کاهش “خطر انقراض” ناشی از فناوری هوش مصنوعی تلاش کنند.

یک بیانیه تک خطی که توسط دهها متخصص، از جمله سام آلتمن که شرکت OpenAI او ربات ChatGPT را ایجاد کرد، امضا کرد، گفت که مقابله با خطرات ناشی از هوش مصنوعی باید “یک اولویت جهانی در کنار سایر خطرات در مقیاس اجتماعی مانند همهگیریها و جنگ هستهای” باشد.

ChatGPT در اواخر سال گذشته مورد توجه قرار گرفت و توانایی تولید مقاله، شعر و مکالمه را از کوتاه ترین درخواست ها نشان داد.موفقیت بینظیر این برنامه با میلیاردها دلار سرمایهگذاری در این زمینه، موجی از هجوم مشابه طلا را به همراه داشت، اما منتقدان و افراد داخلی زنگ خطر را به صدا درآوردهاند.

نگرانیهای رایج شامل این احتمال است که چتباتها میتوانند وب را با اطلاعات نادرست پر کنند، لگوریتمهای مغرضانه مواد نژادپرستانه را تولید میکنند، یا اینکه اتوماسیون مبتنی بر هوش مصنوعی میتواند کل صنایع را از بین ببرد.

ماشین های فوق هوشمند

آخرین بیانیه که در وب سایت مرکز غیرانتفاعی ایمنی هوش مصنوعی مستقر در ایالات متحده قرار گرفته است، هیچ جزئیاتی از تهدید وجودی بالقوه ناشی از هوش مصنوعی ارائه نکرده است.این مرکز گفت که “بیانیه مختصر” به منظور باز کردن بحث در مورد خطرات این فناوری است.

سام آلتمن، رئیس OpenAI میگوید: «اگر مشکلی در هوش مصنوعی پیش بیاید، هیچ ماسک گازی به شما کمک نمیکند».

چندین امضاکننده، از جمله جفری هینتون، که برخی از فناوریهای زیربنایی سیستمهای هوش مصنوعی را ایجاد کرده و به عنوان یکی از پدرخواندههای این صنعت شناخته میشود، در گذشته هشدارهای مشابهی دادهاند.بزرگترین نگرانی آنها ظهور به اصطلاح هوش عمومی مصنوعی (AGI) بوده است – مفهومی که برای لحظه ای تعریف نشده است که ماشین ها قادر به انجام عملکردهای گسترده می شوند و می توانند برنامه نویسی خود را توسعه دهند.

ترس این است که انسان ها دیگر کنترلی بر ماشین های فوق هوشمند نداشته باشند، که کارشناسان هشدار داده اند که می تواند عواقب فاجعه باری برای گونه ها و سیاره زمین داشته باشد.

ده ها نفر از دانشگاهیان و متخصصان شرکت هایی از جمله گوگل و مایکروسافت – که هر دو پیشرو در زمینه هوش مصنوعی هستند – بیانیه را امضا کردند.

این امر دو ماه پس از آن صورت میگیرد که ایلان ماسک، رئیس تسلا و صدها نفر دیگر، نامهای سرگشاده صادر کردند و خواستار توقف در توسعه چنین فناوریهایی شدند تا زمانی که ثابت شود ایمن است.با این حال، نامه ماسک انتقادات گستردهای را برانگیخت مبنی بر اینکه هشدارهای وحشتناک فروپاشی جامعه بسیار اغراقآمیز بوده و اغلب منعکسکننده نکات صحبت تقویتکنندههای هوش مصنوعی است.

امیلی بندر، آکادمیک آمریکایی که در مقالهای با نفوذ در انتقاد از هوش مصنوعی همکاری میکرد، گفت که نامه ماه مارس که توسط صدها شخصیت برجسته امضا شده بود، «هیجانانگیزی هوش مصنوعی بود».

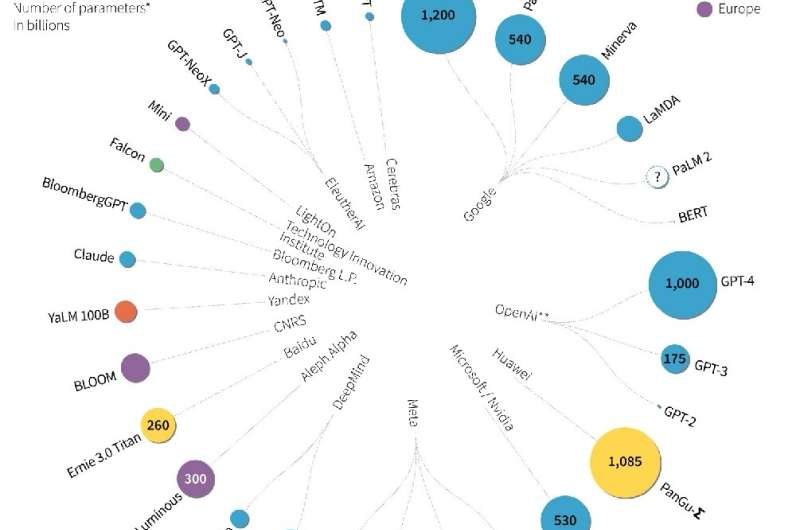

مدل های زبان بزرگ در حال افزایش است.

“به طرز شگفت انگیزی بی طرفانه”

بندر و سایر منتقدان شرکتهای هوش مصنوعی را به دلیل امتناع از انتشار منابع دادههایشان یا افشای نحوه پردازش آنها – به اصطلاح مشکل “جعبه سیاه” مورد انتقاد قرار دادهاند.در میان انتقادات این مهم است که الگوریتمها میتوانند بر روی مطالب نژادپرستانه، جنسیتگرا یا مغرضانه سیاسی آموزش داده شوند.

آلتمن که در حال حاضر به منظور کمک به شکل دادن به گفتگوی جهانی پیرامون هوش مصنوعی در حال سفر به جهان است، چندین بار به تهدید جهانی ناشی از فناوری در حال توسعه شرکتش اشاره کرده است.

او به گروه کوچکی از خبرنگاران در پاریس گفت: «اگر مشکلی در هوش مصنوعی پیش بیاید، هیچ ماسک گازی به شما کمک نمیکند.اما او از امتناع شرکتش از انتشار دادههای منبع دفاع کرد و گفت که منتقدان واقعاً میخواستند بدانند آیا مدلها مغرضانه هستند یا خیر.

او گفت: «نحوه عملکرد آن در آزمون تعصب نژادی چیزی است که در آنجا مهم است.