27 نوامبر 2024 توسط Leo S. Lo, The Conversation-اعتبار: CC0 دامنه عمومی

هوش مصنوعی را میتوان به روشهای بیشماری مورد استفاده قرار داد – و سردردهای اخلاقی که آن را ایجاد میکند نیز بیشمار است.«سازندگان محتوای بزرگسالان» را در نظر بگیرید – نه لزوماً اولین زمینه ای که به ذهن می رسد. در سال 2024، اینفلوئنسرهای تولید شده توسط هوش مصنوعی در اینستاگرام افزایش یافت: مدل های جعلی با چهره های ساخته شده توسط هوش مصنوعی، که به عکس ها و فیلم های دزدیده شده از بدن مدل های واقعی متصل شده بودند. سازندگان محتوای اصلی نه تنها با استفاده از تصاویر خود موافقت نکردند، بلکه غرامتی نیز دریافت نکردند.

در سراسر صنایع، کارگران با سوالات اخلاقی فوری تری در مورد استفاده از هوش مصنوعی هر روز مواجه می شوند. در یک محاکمه توسط شرکت حقوقی Ashurst مستقر در بریتانیا، سه سیستم هوش مصنوعی به طرز چشمگیری بررسی اسناد را سرعت بخشیدند اما نکات ظریف حقوقی را که وکلای مجرب میتوانستند از دست دادند. به طور مشابه، روزنامه نگاران باید کارایی هوش مصنوعی را برای خلاصه کردن تحقیقات پیشینه با دقت مورد نیاز استانداردهای راستیآزمایی متعادل کنند.

این مثال ها تنش فزاینده بین نوآوری و اخلاق را برجسته می کند. کاربران هوش مصنوعی مدیون سازندگانی هستند که کارشان ستون فقرات آن فناوری ها را تشکیل می دهد؟ چگونه در دنیایی که هوش مصنوعی معنای خلاقیت و نقش انسان در آن را به چالش میکشد، حرکت کنیم؟

بهعنوان رئیسی که بر کتابخانههای دانشگاه، برنامههای دانشگاهی و مطبوعات دانشگاه نظارت میکند، هر روز شاهد این هستم که چگونه دانشجویان، کارکنان و اساتید با هوش مصنوعی مولد دست و پنجه نرم میکنند. نگاهی به سه مکتب اخلاقی مختلف میتواند به ما کمک کند تا فراتر از واکنشهای درونی برویم و به سؤالات اصلی در مورد نحوه استفاده از ابزارهای هوش مصنوعی با صداقت و صداقت پاسخ دهیم.

در هسته خود، اخلاق دئونتولوژیک این سوال را مطرح می کند که افراد چه وظایف اساسی در قبال یکدیگر دارند – چه چیزی درست است یا نادرست، صرف نظر از پیامدها.

این رویکرد که در هوش مصنوعی اعمال می شود، بر حقوق و تعهدات اساسی تمرکز دارد. از طریق این لنز، ما باید نه تنها آنچه را که هوش مصنوعی ما را قادر میسازد، بررسی کنیم، بلکه باید بررسی کنیم که چه مسئولیتهایی در قبال سایر افراد در جوامع حرفهای خود داریم.

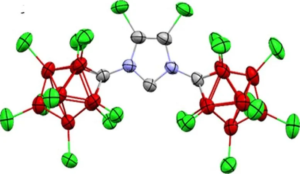

به عنوان مثال، سیستمهای هوش مصنوعی اغلب با تجزیه و تحلیل مجموعههای وسیعی از آثار خلق شده توسط انسان، یاد میگیرند که مفاهیم سنتی حقوق خلاق را به چالش میکشد. عکاسی که از کارش برای آموزش یک مدل هوش مصنوعی استفاده شده است، ممکن است این سوال را مطرح کند که آیا کار آنها بدون غرامت منصفانه تخصیص داده شده است یا خیر – آیا مالکیت اصلی آنها بر کارشان نقض شده است یا خیر.

از سوی دیگر، اخلاق deontological نیز بر وظایف مثبت افراد در قبال دیگران تأکید میکند – مسئولیتهایی که برخی برنامههای هوش مصنوعی میتوانند به انجام آنها کمک کنند. هدف سازمان غیرانتفاعی ترجیملی استفاده از یک پلتفرم مبتنی بر هوش مصنوعی برای ارتباط پناهندگان با مترجمان داوطلب است. ابزار هوش مصنوعی سازمان همچنین ترجمه بلادرنگی را ارائه میکند که داوطلبان انسانی میتوانند برای دقت آن را اصلاح کنند.

این تمرکز دوگانه بر احترام به حقوق پدیدآورندگان در حین انجام وظایف در قبال افراد دیگر نشان میدهد که چگونه اخلاق اخلاقی میتواند استفاده اخلاقی از هوش مصنوعی را هدایت کند.

رویکرد دیگر از نتیجهگرایی ناشی میشود، فلسفهای که اعمال را بر اساس نتایجشان ارزیابی میکند. این دیدگاه تمرکز را از حقوق و مسئولیت های افراد به اثرات گسترده تر هوش مصنوعی تغییر می دهد. آیا مزایای بالقوه هوش مصنوعی مولد تأثیر اقتصادی و فرهنگی را توجیه می کند؟ آیا هوش مصنوعی نوآوری را به قیمت معیشت خلاق پیش می برد؟

این تنش اخلاقی سنجیدن منافع و مضرات، بحثها و دعواهای حقوقی فعلی را به راه میاندازد. سازمان هایی مانند Getty Images اقدامات قانونی را برای محافظت از کار مشارکت کنندگان انسانی در برابر آموزش غیرمجاز هوش مصنوعی انجام داده اند. برخی از پلتفرمهایی که از هوش مصنوعی برای ایجاد تصاویر استفاده میکنند، مانند DeviantArt و Shutterstock، به هنرمندان گزینههایی برای انصراف یا دریافت غرامت ارائه میدهند، تغییری به سمت به رسمیت شناختن حقوق خلاقیت در عصر هوش مصنوعی.

پیامدهای اتخاذ هوش مصنوعی بسیار فراتر از حقوق خالقان است و می تواند اساساً صنایع خلاق را تغییر دهد. بخشهای انتشارات، سرگرمی و طراحی با اتوماسیون بیسابقهای مواجه هستند که میتواند بر کارگران در کل خط تولید، از مفهومسازی تا توزیع، تأثیر بگذارد.

این اختلالات باعث ایجاد مقاومت قابل توجهی شده است. برای مثال، در سال 2023، اتحادیه های کارگری فیلمنامه نویسان و بازیگران دست به اعتصاب هایی زدند که باعث توقف تولیدات هالیوود شد.با این حال، رویکرد نتیجهگرایانه ما را وادار میکند تا فراتر از تهدیدات اقتصادی فوری، یا حقوق و مسئولیتهای افراد نگاه کنیم تا تأثیر اجتماعی گستردهتر هوش مصنوعی را بررسی کنیم. از این منظر گسترده تر، نتیجه گرایی نشان می دهد که نگرانی ها در مورد آسیب های اجتماعی باید با منافع اجتماعی بالقوه متعادل شود.

ابزارهای پیشرفته هوش مصنوعی در حال حاضر زمینه هایی مانند تحقیقات علمی، تسریع کشف دارو و راه حل های تغییر آب و هوا را متحول کرده اند. در آموزش، هوش مصنوعی از یادگیری شخصی برای دانشآموزان در حال مبارزه پشتیبانی میکند. کسبوکارهای کوچک و کارآفرینان در مناطق در حال توسعه اکنون میتوانند با دسترسی به قابلیتهای سطح حرفهای که زمانی مختص شرکتهای بزرگتر بود، در سطح جهانی رقابت کنند.

حتی هنرمندان باید جوانب مثبت و منفی تاثیر هوش مصنوعی را بسنجید: فقط این نیست ، جوانب منفی هوش مصنوعی راه های جدیدی را برای بیان خلاقیت، مانند موسیقی و هنرهای بصری تولید شده توسط هوش مصنوعی ایجاد کرده است. این فناوریها ترکیببندیها و تصاویر بصری پیچیدهای را امکانپذیر میکنند که ممکن است تولید با دست چالشبرانگیز باشد و آن را به یک همکار با ارزش ویژه برای هنرمندان دارای معلولیت تبدیل کند.

اخلاق فضیلت، رویکرد سوم، این سوال را مطرح میکند که چگونه استفاده از هوش مصنوعی باعث میشود که کاربران حرفهای و مردم شوند. برخلاف رویکردهایی که بر قواعد یا پیامدها تمرکز دارند، این چارچوب بر شخصیت و قضاوت متمرکز است.

موارد اخیر نشان می دهد که چه چیزی در خطر است. اتکای یک وکیل به استنادهای حقوقی ایجاد شده توسط هوش مصنوعی منجر به تحریم های دادگاه شد و نشان داد که چگونه اتوماسیون می تواند تلاش حرفه ای را از بین ببرد. در مراقبتهای بهداشتی، کشف تعصب نژادی در چترباتهای هوش مصنوعی پزشکی، ارائهدهندگان را مجبور کرد تا با این که چگونه اتوماسیون ممکن است تعهد آنها به مراقبت عادلانه را به خطر بیندازد، مقابله کنند.

این شکست ها حقیقت عمیق تری را آشکار می کند: تسلط بر هوش مصنوعی مستلزم پرورش قضاوت صحیح است. صداقت حرفه ای وکلا ایجاب می کند که ادعاهای ایجاد شده توسط هوش مصنوعی را تأیید کنند. تعهد پزشکان به رفاه بیمار مستلزم زیر سوال بردن توصیه های هوش مصنوعی است که ممکن است تعصب را تداوم بخشد. هر تصمیم برای استفاده یا رد ابزارهای هوش مصنوعی نه تنها نتایج فوری بلکه شخصیت حرفه ای را شکل می دهد.کارگران انفرادی اغلب کنترل محدودی بر نحوه اجرای AI در محل کارشان دارند، بنابراین بسیار مهمتر است که سازمان های حرفه ای دستورالعمل های روشنی را ایجاد کنند. علاوه بر این، افراد به فضایی برای حفظ یکپارچگی حرفه ای در قوانین کارفرمایان خود نیاز دارند تا قضاوت صحیح خود را اعمال کنند.

فراتر از پرسیدن “آیا هوش مصنوعی می تواند این کار را انجام دهد؟” سازمان ها باید در نظر بگیرند که چگونه اجرای آن می تواند بر قضاوت و عملکرد حرفه ای کارگران تأثیر بگذارد. در حال حاضر، فناوری در استفاده از آن سریعتر از خرد جمعی در حال تکامل است و تفکر عمدی و تمرین مبتنی بر فضیلت را ضروریتر از همیشه میکند.

هر یک از این سه چارچوب اخلاقی جنبه های مختلف معضل هوش مصنوعی جامعه ما را روشن می کند.

تفکر مبتنی بر حقوق، تعهدات ما را در قبال سازندگانی که کارشان سیستمهای هوش مصنوعی را آموزش میدهد، برجسته میکند. نتیجهگرایی هم مزایای گستردهتر دموکراسیسازی هوش مصنوعی و هم تهدیدات بالقوه آن، از جمله برای معیشت خلاق را نشان میدهد. اخلاق فضیلت نشان می دهد که چگونه انتخاب های فردی در مورد هوش مصنوعی نه تنها نتایج بلکه شخصیت حرفه ای را شکل می دهد.

این دیدگاه ها با هم نشان می دهد که استفاده اخلاقی از هوش مصنوعی به چیزی بیش از دستورالعمل های جدید نیاز دارد. این نیاز به بازنگری در نحوه ارزش گذاری کار خلاق دارد.

بحث در مورد هوش مصنوعی اغلب شبیه نبرد بین نوآوری و سنت است. اما این چارچوب چالش واقعی را از دست می دهد: توسعه رویکردهایی که هم خلاقیت انسان و هم پیشرفت فناوری را ارج می نهد و به آنها اجازه می دهد یکدیگر را تقویت کنند. در هسته خود، این تعادل به ارزش ها بستگی دارد.