1 مه 2023 – توسط دانیل لالر-اسکنهای دستگاه fMRI به دانشمندان این امکان را داد تا نقشهبرداری کنند که چگونه معانی و عبارات باعث واکنشها در مناطق مختلف مغز میشوند.

دانشمندان گفتند راهی برای استفاده از اسکن مغز و مدلسازی هوش مصنوعی برای رونویسی «خلاصه» آنچه که مردم فکر میکنند، در چیزی که به عنوان گامی به سوی ذهنخوانی توصیف شد، یافتهاند.

در حالی که هدف اصلی رمزگشای زبان کمک به افرادی است که توانایی برقراری ارتباط را از دست داده اند، دانشمندان آمریکایی اذعان کردند که این فناوری سوالاتی را در مورد “حریم خصوصی ذهنی” ایجاد کرده است.

با هدف کاهش چنین ترسهایی، آنها آزمایشهایی را انجام دادند که نشان میداد رمزگشای آنها نمیتواند بر روی افرادی که اجازه ندادهاند در یک اسکنر تصویربرداری تشدید مغناطیسی عملکردی (fMRI) در مورد فعالیتهای مغزی خود در ساعات طولانی آموزش ببینند، استفاده شود.

تحقیقات قبلی نشان داده است که ایمپلنت مغزی میتواند افرادی را که دیگر نمیتوانند صحبت یا تایپ کنند قادر میسازد تا کلمات یا حتی جملات را تلفظ کنند.این “رابط مغز و کامپیوتر” بر بخشی از مغز تمرکز می کند که هنگام تلاش برای تشکیل کلمات، دهان را کنترل می کند.

الکساندر هوث، عصب شناس در دانشگاه تگزاس در آستین و یکی از نویسندگان یک مطالعه جدید، گفت که رمزگشای زبان تیمش “در سطح بسیار متفاوتی کار می کند”.

هوث در یک کنفرانس مطبوعاتی آنلاین گفت: «سیستم ما واقعاً در سطح ایدهها، معناشناسی و معنا کار میکند.

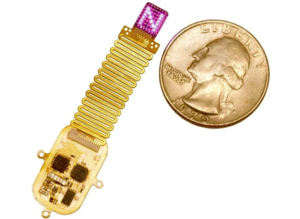

بر اساس این مطالعه در مجله Nature Neuroscience، این اولین سیستمی است که قادر به بازسازی زبان مداوم بدون ایمپلنت مغزی تهاجمی است.برای این مطالعه، سه نفر در مجموع 16 ساعت را در دستگاه fMRI صرف گوش دادن به داستانهای روایی گفتاری، عمدتاً پادکستهایی مانند عشق مدرن نیویورک تایمز کردند.این به محققان اجازه داد تا نقشهبرداری کنند که چگونه کلمات، عبارات و معانی پاسخها را در مناطقی از مغز که برای پردازش زبان شناخته شدهاند، تحریک میکنند.

آنها این داده ها را به یک مدل زبان شبکه عصبی که از GPT-1، سلف فناوری هوش مصنوعی که بعداً در ChatGPT بسیار محبوب استفاده شد، وارد کردند.این مدل برای پیشبینی چگونگی واکنش مغز هر فرد به گفتار درک شده آموزش داده شد، سپس گزینهها را محدود کرد تا نزدیکترین پاسخ را پیدا کرد.

برای آزمایش دقت مدل، هر یک از شرکتکنندگان سپس به داستان جدیدی در دستگاه fMRI گوش دادند.

جری تانگ، نویسنده اول این مطالعه، گفت که رمزگشا میتواند «محصول آنچه کاربر میشنود را بازیابی کند».

به عنوان مثال، هنگامی که شرکت کننده عبارت “من هنوز گواهینامه رانندگی خود را ندارم” را شنید، مدل برگشت با این جمله “او هنوز شروع به یادگیری رانندگی نکرده است”.

محققان اذعان کردند که رمزگشا با ضمایر شخصی مانند “من” یا “او” مشکل داشت.اما حتی زمانی که شرکتکنندگان داستانهای خود را میاندیشیدند – یا فیلمهای صامت را تماشا میکردند – رمزگشا همچنان میتوانست «خلاصه» را درک کند.

این نشان داد که “ما چیزی را که عمیق تر از زبان است رمزگشایی می کنیم، سپس آن را به زبان تبدیل می کنیم.”

Huth گفت: از آنجایی که اسکن fMRI برای ضبط کلمات بسیار آهسته است، مجموعه ای از اطلاعات را در چند ثانیه جمع آوری می کند ، بنابراین ما می توانیم ببینیم که این ایده چگونه تکامل می یابد، حتی اگر کلمات دقیق گم شوند.

دیوید رودریگز-آریاس وایلن، استاد اخلاق زیستی در دانشگاه گرانادای اسپانیا که در این تحقیق شرکت نداشت، گفت که این امر فراتر از آنچه که توسط رابط های قبلی مغز و کامپیوتر به دست آمده بود، فراتر رفت.

او گفت که این ما را به آینده ای نزدیک می کند که در آن ماشین ها می توانند “ذهن ها را بخوانند و افکار را رونویسی کنند”، و هشدار داد که این ممکن است بر خلاف میل افراد اتفاق بیفتد، مانند زمانی که آنها در خواب هستند.

محققان چنین نگرانی هایی را پیش بینی کردند.آنها آزمایشهایی را انجام دادند که نشان میداد رمزگشا بر روی فردی کار نمیکند، اگر قبلاً در مورد فعالیت مغزی خاص خود آموزش ندیده باشد.

هنگام گوش دادن به یکی از پادکست ها، به کاربران گفته شد که هفت بشمارند، حیوانات را نام ببرند و تصور کنند یا داستان متفاوتی را در ذهن خود تعریف کنند. به گفته محققان، تمام این تاکتیکها رمزگشا را خراب کردند.

در مرحله بعد، تیم امیدوار است که روند را سرعت بخشد تا بتوانند اسکن های مغز را در زمان واقعی رمزگشایی کنند.آنها همچنین خواستار قوانینی برای محافظت از حریم خصوصی ذهنی شدند.رودریگز-آریاس وایلن، متخصص اخلاق زیستی، گفت: «ذهن ما تا کنون حافظ حریم خصوصی ما بوده است.این کشف می تواند اولین گام برای به خطر انداختن این آزادی در آینده باشد.”