13 سپتامبر 2022 -توسط آزمایشگاه ملی لوس آلاموس

محققان در لوس آلاموس به دنبال روش های جدیدی برای مقایسه شبکه های عصبی هستند. این تصویر با یک نرم افزار هوش مصنوعی به نام Stable Diffusion و با استفاده از متن “نگاه کردن به جعبه سیاه شبکه های عصبی” ساخته شده است. اعتبار: آزمایشگاه ملی لوس آلاموس

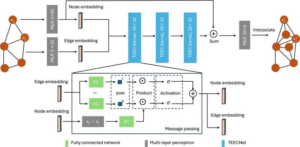

تیمی در آزمایشگاه ملی لوس آلاموس رویکرد جدیدی را برای مقایسه شبکههای عصبی که درون جعبه سیاه هوش مصنوعی است، توسعه دادهاند تا به محققان در درک رفتار شبکههای عصبی کمک کند. شبکه های عصبی الگوهای موجود در مجموعه داده ها را تشخیص می دهند. آنها در همه جای جامعه، در برنامه هایی مانند دستیارهای مجازی، سیستم های تشخیص چهره و خودروهای خودران استفاده می شوند.

هایدن جونز، محقق در تحقیقات پیشرفته در سایبر گروه سیستم در لس آلاموس، گفت: «جامعه تحقیقاتی هوش مصنوعی لزوماً درک کاملی از آنچه شبکههای عصبی انجام میدهند ندارند؛ آنها نتایج خوبی به ما میدهند، اما ما نمیدانیم چگونه و چرا». روش جدید ما کار بهتری را در مقایسه شبکههای عصبی انجام میدهد که گامی مهم در جهت درک بهتر ریاضیات پشت هوش مصنوعی است.

“اگر شما یک نفر را آموزش داده اید، همه آنها را آموزش داده اید: تشابه بین معماری با استحکام افزایش می یابد”. این مقاله علاوه بر مطالعه شباهت شبکه، گامی مهم در جهت توصیف رفتار شبکههای عصبی قوی است.

شبکه های عصبی با کارایی بالا، اما شکننده هستند. به عنوان مثال، اتومبیل های خودران از شبکه های عصبی برای تشخیص علائم استفاده می کنند. وقتی شرایط ایده آل باشد، آنها این کار را به خوبی انجام می دهند. با این حال، کوچکترین انحراف – مانند برچسب روی علامت توقف – می تواند باعث شود شبکه عصبی علامت را اشتباه شناسایی کند و هرگز متوقف نشود.

برای بهبود شبکه های عصبی، محققان به دنبال راه هایی برای بهبود استحکام شبکه هستند. یک رویکرد پیشرفته شامل “حمله” به شبکه ها در طول فرآیند آموزش آنها است. محققان عمداً انحرافات را معرفی می کنند و هوش مصنوعی را آموزش می دهند تا آنها را نادیده بگیرد. این فرآیند آموزش خصمانه نامیده می شود و اساسا فریب شبکه ها را سخت تر می کند.

جونز، همکاران لس آلاموس، جاکوب اسپرینگر و گرت کنیون، و جاستون مور، مربی جونز، معیار جدید شباهت شبکه خود را در شبکههای عصبی آموزشدیده اعمال کردند و بهطور شگفتانگیزی دریافتند که آموزش خصمانه باعث میشود شبکههای عصبی نمایش داده های بسیار مشابه، صرف نظر از معماری شبکه، با افزایش بزرگی حمله.در حوزه بینایی رایانه به هم نزدیک شوند.

جونز گفت: «ما متوجه شدیم که وقتی شبکههای عصبی را به گونهای آموزش میدهیم که در برابر حملات متخاصم قوی باشند، آنها شروع به انجام کارهای مشابه میکنند.

تلاشهای گستردهای در صنعت و جامعه دانشگاهی برای جستجوی «معماری مناسب» برای شبکههای عصبی صورت گرفته است، اما یافتههای تیم Los Alamos نشان میدهد که معرفی آموزشهای خصمانه این فضای جستجو را به طور قابلتوجهی محدود میکند. در نتیجه، جامعه تحقیقاتی هوش مصنوعی ممکن است نیازی به صرف زمان زیادی برای کاوش در معماریهای جدید نداشته باشد، زیرا میدانند که آموزش رقیب باعث میشود معماریهای متنوع به راهحلهای مشابه همگرا شوند.

جونز میگوید: “با یافتن شباهتهای شبکههای عصبی قوی به یکدیگر، درک اینکه چگونه هوش مصنوعی قوی واقعاً ممکن است کار کند را آسانتر میکنیم. حتی ممکن است نکاتی را در مورد چگونگی ادراک در انسان و سایر حیوانات کشف کنیم.”