20 سپتامبر 2022 – توسط J. Merritt Melancon، دانشگاه جورجیا-شماتیک رویه آزمایشی.

با تصحیح خودکار و پاسخهای ایمیلی که بهطور خودکار ایجاد میشوند، الگوریتمها کمکهای زیادی را برای کمک به افراد برای بیان خود ارائه میدهند.اما تحقیقات جدید دانشگاه جورجیا نشان میدهد افرادی که برای کمک به کارهای خلاقانه مرتبط با زبان به الگوریتمهای رایانهای تکیه میکنند، عملکرد خود را بهبود نمیبخشند و بیشتر به توصیههای با کیفیت پایین اعتماد میکنند.

Aaron Schecter، استادیار سیستمهای اطلاعات مدیریت در کالج تجارت تری، مطالعه خود را با عنوان «ترجیحات انسانی نسبت به توصیههای الگوریتمی در یک وظیفه تداعی کلمات» در این ماه در Scientific Reports منتشر کرد. نویسندگان همکار او نینا لاوهاراتاناهیرون، استادیار سلامت زیست رفتاری در دانشگاه ایالتی پنسیلوانیا، و دکترای اخیر کالج تری و اریک بوگرت فارغ التحصیل و استادیار فعلی دانشگاه نورث ایسترن هستند..

این مقاله دومین مقاله در تحقیقات تیم در مورد اعتماد فردی به توصیه های تولید شده توسط الگوریتم ها است. در مقاله آوریل 2021، این تیم دریافت که افراد در شمارش وظایف بیشتر به توصیه های الگوریتمی متکی هستند تا توصیه هایی که ظاهراً توسط سایر شرکت کنندگان ارائه شده است.

این مطالعه با هدف بررسی این موضوع انجام شد که آیا افراد هنگام انجام کارهای خلاقانه و وابسته به زبان، توصیه های رایانه را به تعویق می اندازند یا خیر. تیم دریافت که شرکت کنندگان 92.3 درصد بیشتر از توصیه های منتسب به افراد استفاده می کنند.

Schecter گفت: «این کار به همان نوع تفکر نیاز نداشت (مثل کار شمارش در مطالعه قبلی) اما در واقع ما همان تعصبات را دیدیم. آنها همچنان میخواستند از پاسخ الگوریتم استفاده کنند و احساس خوبی نسبت به آن داشته باشند، اگرچه این به آنها کمکی نمیکند که بهتر عمل کنند.»

استفاده از الگوریتم در حین تداعی کلمه

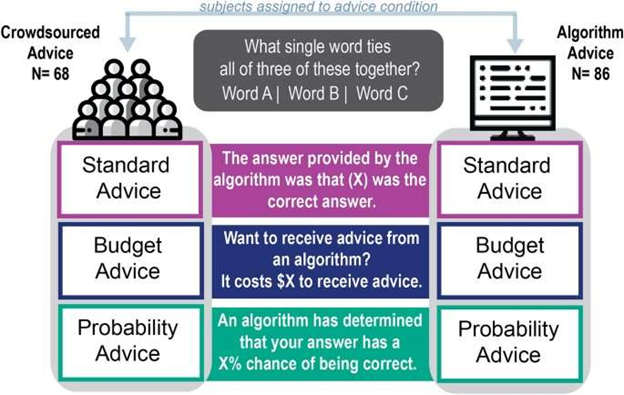

Schecter و همکارانش برای اینکه ببینند آیا مردم بیشتر به توصیههای کامپیوتری برای کارهای مرتبط با زبان تکیه میکنند یا خیر، به ۱۵۴ شرکتکننده آنلاین بخشهایی از Remote Associates Test را دادند، آزمونی که به مدت شش دهه برای ارزیابی خلاقیت شرکتکنندگان مورد استفاده قرار میگرفت.

او گفت: «این خلاقیت محض نیست، اما تداعی کلمات اساساً نوع کار متفاوتی با ساختن یک تصویر استوک یا شمارش اشیاء در عکس است، زیرا شامل زبانشناسی و توانایی تداعی ایدههای مختلف است. ما این موضوع را ذهنیتر میدانیم، اگرچه پاسخ درستی برای سؤالات وجود دارد.»

در طول آزمون، از شرکت کنندگان خواسته شد تا کلمه ای بیاورند که سه کلمه نمونه را به هم پیوند می زند. اگر مثلاً کلمات پایه، اتاق و بولینگ بود، جواب توپ بود.

شرکتکنندگان کلمهای را برای پاسخ به سؤال انتخاب کردند و به آنها یک راهنمایی نسبت داده شده به یک الگوریتم یا یک اشاره منتسب به یک شخص ارائه شد و به آنها اجازه داده شد که پاسخهای خود را تغییر دهند. ترجیح توصیه های مشتق شده از الگوریتم علیرغم دشواری سؤال، نحوه بیان توصیه یا کیفیت توصیه قوی بود.

شرکتکنندگانی که از توصیههای الگوریتم استفاده میکردند نیز دو برابر افرادی که از توصیههای فرد استفاده میکردند، به پاسخهای خود اطمینان داشتند. علیرغم اطمینان آنها به پاسخهایشان، احتمال 13 درصد کمتر از کسانی که از توصیههای مبتنی بر انسان برای انتخاب پاسخهای صحیح استفاده میکردند، داشتند.

او گفت: «من نمیخواهم بگویم که این توصیهها باعث بدتر شدن وضع مردم میشد، اما این واقعیت که آنها بهتر عمل نکردند و در عین حال احساس بهتری نسبت به پاسخهایشان داشتند، مشکل را نشان میدهد. “اعتماد به نفس آنها بالا رفت، بنابراین احتمالاً از توصیه های الگوریتمی استفاده می کنند و احساس خوبی در مورد آن دارند، اما لزوماً درست نخواهند بود.

آیا هنگام نوشتن ایمیل باید تصحیح خودکار را بپذیرید؟

“اگر من یک عملکرد تکمیل خودکار یا تصحیح خودکار در ایمیل خود داشته باشم که به آن اعتقاد دارم، ممکن است به این فکر نکنم که آیا این کار حال من را بهتر می کند یا خیر. من فقط از آن استفاده می کنم زیرا در انجام آن احساس اطمینان دارم.”

Schechter و همکارانش این تمایل به پذیرش توصیه های تولید شده توسط کامپیوتر را بدون توجه به کیفیت آن به عنوان سوگیری اتوماسیون می نامند. درک اینکه چگونه و چرا تصمیم گیرندگان انسانی برای حل مشکلات از نرم افزار یادگیری ماشینی خودداری می کنند، بخش مهمی از درک اینکه چه چیزی در محیط های کاری مدرن ممکن است اشتباه باشد و نحوه اصلاح آن است.

Schecter میگوید: «اغلب وقتی صحبت میکنیم که آیا میتوانیم به الگوریتمها اجازه تصمیمگیری بدهیم، وجود یک فرد در حلقه به عنوان راهحلی برای جلوگیری از اشتباهات یا نتایج بد ارائه میشود. “اما اگر افراد بیشتر از آنچه الگوریتم توصیه می کند به تعویق نیفتند، این نمی تواند راه حلی باشد.”